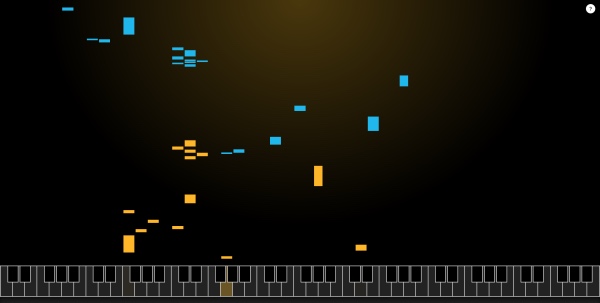

谷歌人工智能二重奏 机器人与人钢琴合奏

谷歌半年多以前公布推出可以演奏钢琴的人工智能程序,该人工智能程序可以将一些给定的音符变成一首歌。搜索巨头谷歌日前决定与全世界分享旗下的人工智能二重奏网络应用程序。

YotamMann是一名音乐家,同时也是码农,他是上述新的人工智能程序的幕后人。他在谷歌Magenta和Creative Labs团队的帮助下创建该人工智能程序。Mann在一个视频中解释了该人工智能程序幕后的过程以及人工智能程序如何在拿到乐谱后即时弹奏新的音乐。

Mann表示,“利用代码做音乐并不是新事物,但机器学习为我们提供了一个不同的方法。假如我试图用更传统的编程去写人工智能二重奏程序的话,那我就必须写许多规则。”

曼解释说,假如用人工智能编程的旧方法,他就必须告诉计算机如何去对各种输入作出响应,而各种可能的输入非常多,要这样做是不可能的。他表示,“我主要是创建一个映射去告诉计算机如何做出这些决定,但音符和时间的组合太多,用人手映射是做不到的。”

Mann用神经网络训练人工智能二重奏程序,而不是用特定的规则编程。神经网络技术的工作原理有些像人类的大脑,一些人工神经元合力构成连接并且强化现存的知识。

谷歌将大量音符组合输送给上述的人工智能程序,该人工智能程序从这些数据里学习常常同时演奏或先后演奏的音符之间的连接、时间关系等等。你弹了几个音符后,人工智能二重奏程序就会将其数据与神经网络里的连接比较,再决定从几种可能里选一个连接演奏。Mann表示,不管你给的是什么,人工智能二重奏程序都会尝试给你伴奏,即使你砸几下键盘,它也会以相应的节奏和旋律给你伴奏。

Mann构建人工智能二重奏程序用到Magenta。Magenta是一个谷歌大脑团队用TensorFlow建造的开源深度学习库。人工智能二重奏的代码也是开源的,所以如果你想建造一款自己的演奏钢琴的机器人,现在可以开始了。

笔者与谷歌人工智能二重奏程序演奏的结果不是特别顺溜,但或许人工智能二重奏程序的弹奏水平不会超过弹奏伙伴吧。不管怎么样,人工智能二重奏程序还是没可能和我们玩“筷子”法合奏。

好文章,需要你的鼓励

奥运级别的努力:首席信息官为2026年AI颠覆做准备

AI颠覆预计将在2026年持续,推动企业适应不断演进的技术并扩大规模。国际奥委会、Moderna和Sportradar的领导者在纽约路透社峰会上分享了他们的AI策略。讨论焦点包括自建AI与购买第三方资源的选择,AI在内部流程优化和外部产品开发中的应用,以及小型模型在日常应用中的潜力。专家建议,企业应将AI建设融入企业文化,以创新而非成本节约为驱动力。

字节跳动发布GAR:让AI能像人类一样精准理解图像任何区域的突破性技术

字节跳动等机构联合发布GAR技术,让AI能同时理解图像的全局和局部信息,实现对多个区域间复杂关系的准确分析。该技术通过RoI对齐特征重放方法,在保持全局视野的同时提取精确细节,在多项测试中表现出色,甚至在某些指标上超越了体积更大的模型,为AI视觉理解能力带来重要突破。

Spotify推出AI播放列表功能让用户掌控推荐算法

Spotify在新西兰测试推出AI提示播放列表功能,用户可通过文字描述需求让AI根据指令和听歌历史生成个性化播放列表。该功能允许用户设置定期刷新,相当于创建可控制算法的每周发现播放列表。这是Spotify赋予用户更多控制权努力的一部分,此前其AI DJ功能也增加了语音提示选项,反映了各平台让用户更好控制算法推荐的趋势。

Inclusion AI推出万亿参数思维模型Ring-1T:首个开源的超大规模推理引擎如何重塑AI思考边界

Inclusion AI团队推出首个开源万亿参数思维模型Ring-1T,通过IcePop、C3PO++和ASystem三项核心技术突破,解决了超大规模强化学习训练的稳定性和效率难题。该模型在AIME-2025获得93.4分,IMO-2025达到银牌水平,CodeForces获得2088分,展现出卓越的数学推理和编程能力,为AI推理能力发展树立了新的里程碑。

为全天候绿电而生,海辰储能发布全球首个原生8小时长时储能解决方案

为AI+而生,海辰储能发布全球首款锂钠协同AIDC全时长储能解决方案

长时储能开启智慧未来:海辰储能生态日全球首发三大新品

Arm 借助融合型 AI 数据中心,重塑计算格局

奥运级别的努力:首席信息官为2026年AI颠覆做准备

Spotify推出AI播放列表功能让用户掌控推荐算法

Adobe押注生成式AI获得回报,年度营收创历史新高

OpenAI与迪士尼达成十亿美元合作协议,米老鼠和漫威角色进入Sora

甲骨文150亿美元数据中心投资导致股价下跌

Spoor鸟类监测AI软件需求飞速增长

制药行业AI数据质量危机:垃圾进垃圾出的隐患

Harness获得2.4亿美元融资,估值达55亿美元,专注自动化AI编码后的开发流程