谷歌云新增Nvidia GPU为机器学习提速 原创

至顶网软件频道消息:Google宣布在多个地区上线新的Nvidia GPU,希望以此更多用户在Google云中运行他们的机器学习和人工智能工作负载。

专用的云GPU(例如Nvidia开发的GPU)旨在加速机器学习训练和推理、地球物理数据处理、模拟、地震分析和分析建模等工作负载。

Google Compute Engine产品经理Chris Kleban和Ari Liberman在近日的一篇博客文章中表示,Google已经宣布开始测试Nvidia的P100 GPU。此外据称Nvidia的K80 GPU现在也已经出货了。他们补充说,Google将在这些GPU上提供“持续使用折扣”,以鼓励客户利用这些GPU。

说到Nvidia的Tesla P100 GPU,Google将其描述为“最先进的”处理器,允许客户以更少的实例提升吞吐量,同时节约成本。

Google还指出了云GPU与传统GPU相比的一些优点,首先就是提高了灵活性,因为这种GPU可让从中央处理器到内存再到磁盘大小和GPU配置的方方面面都可定制化,以满足客户的需求。

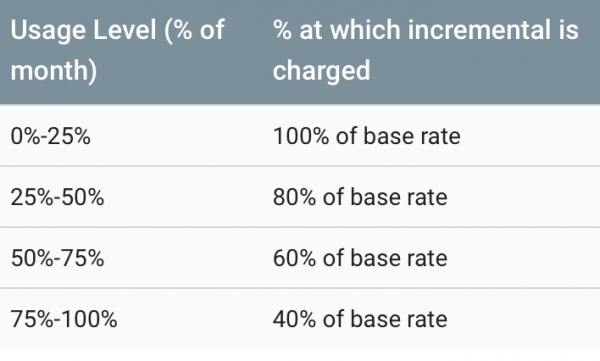

其次,就是云GPU可提高性能,以及降低成本,因为下图详细列举的持续使用折扣。最后,Google还强调了一个优点“云集成”,并称现在Google云堆栈的所有层面都提供了云GPU。

两位工程师这样写到:“对于基础设施来说,Compute Engine和Google Container Engine让你可以对虚拟机或者容器运行你的GPU工作负载。对于机器学习来说,Cloud Machine Learning可以选配GPU以缩短利用TensorFlow大规模训练模型的时间。”

Google还补充说,新增的GPU将在率先4个地区提供,包括美国东部、美国西部、欧洲西部和亚洲东部。

Google表示,看到了一些客户在一系列计算密集型任务中使用新的GPU,包括基因组学、计算金融和机器学习模型训练。Google表示,两种不同芯片的选择为客户提供了更多的灵活性,因为客户可以选择最合适的芯片来优化他们工作负载、同时平衡性能与定价。

好文章,需要你的鼓励

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

今天讲的出海案例是明阳电气,这家输配电设备公司在马来西亚投产首个海外生产基地,并以 250 万林吉特子公司承接本地制造。

阿里巴巴与北京大学联手:让AI在“走错路“时及时悬崖勒马,训练效率提升超20%

阿里巴巴通义实验室与北京大学联合提出ESPO方法,让语言模型强化学习训练时能在推理走偏时及时截断,节省超20%计算资源,同步提升数学推理准确率。

Canva推出Perplexity Computer连接器,助力智能体自动生成设计资产

Canva正式发布适用于Perplexity Computer平台的连接器,允许Perplexity桌面智能代理自主将数据和提示词转化为可编辑的Canva设计资产。用户只需通过连接器页面接入Canva,描述需求,Perplexity便可结合会议记录、业务数据及实时网络内容,自动生成演示文稿、社交媒体素材、信息图表或品牌视觉套件。该功能目前面向Perplexity Pro、Max及企业版用户开放。

上交大与小红书联合出招:给AI大脑的“训练方式“动了个小手术,效果却出奇地好

NITP是上海交通大学等机构提出的大语言模型预训练新目标,通过让模型预测下一词的浅层语义表示,解决标准训练中内部表示退化问题,仅增加约2%训练开销即可提升下游任务表现。

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

三星Health应用迎来重大AI改版,为Galaxy Watch 9铺路

Sonos Play 评测:便携智能音箱新标杆

Dashlane披露攻击者如何成功下载加密密码库

Axelera AI与Andes Technology携手,以高性能RISC-V AX65核心赋能下一代"Europa"AI平台

沃尔沃与Boliden完成自动驾驶运输大坝建设里程碑

思科Cisco Live大会五大核心要点解读

Cloudflare收购VoidZero:整合Vite工具链,布局AI驱动的Web开发

理性看待网络上疯传的人形机器人视频

AI智能体网络流量首次超越真实人类流量

Airbnb创始人布莱恩·切斯基计划创建全新AI实验室

Anthropic联合创始人:AI回报质疑不足为虑,IPO计划稳步推进