微软将Visual Studio与AI服务整合 原创

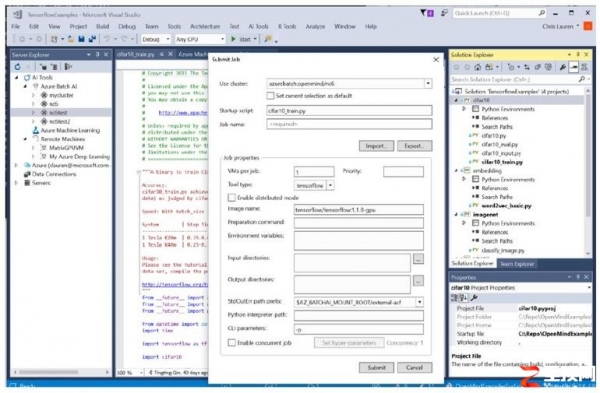

在9月份的Ignite会议上,微软公布了一个将Visual Studio Code与其AI服务集成在一起的扩展。在今天(11月15日)的Connect会议上,微软为Visual Studio本身添加了一个能与人工智能服务集成在一起的扩展功能。

上述第二个扩展被称为Visual Studio Tools for AI,同时支持微软和第三方深度学习框架。它支持微软认知工具包(Microsoft Cognitive Toolkit ,CNTK)、Google TensorFlow、Theano、Keras、Caffe2等。微软方面表示,Visual Studio Tools for AI利用了现有的对Python、C / C ++ / C#的代码支持,并为Cognitive Toolkit BrainScript提供额外的支持。

Visual Studio Tools for AI和Visual Studio Code for AI都是微软机器学习套件的一部分——该套件代码代号为“Open Mind Studio”——这是该公司在一年前的官方介绍。微软最近推出的Azure Machine Learning Workbench也会同这个套件协同工作。

微软方面在2016年将Open Mind Studio描述为“机器学习的Visual Studio”。如前所述,Open Mind Studio的设计目标是可用于各种CPU / GPU、FPGA、云和客户端设备。它可以运行在联合基础架构之上,同时支持各种深度学习框架、开源计算框架(如Hadoop和Spark),专门优化的计算框架以及他们构建的其他框架。

来源:ZDNet

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元