OpenAI发布可加速GPU机器学习的核心工具库 原创

至顶网软件频道消息: OpenAI研究人员日前发布了一个工具库,该工具库可以帮助研究人员在GPU上建立更快、更高效、占内存更少的神经网络。

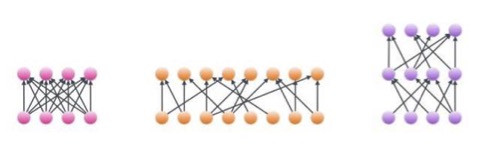

神经网络由一些连接节点层组成。神经网络的结构处决于数据和应用程序,各种结构的变化可以很大,但所有的模型都受到GPU运行方式的限制。

一种使用较小的计算达到训练较大模型的方法是使用稀疏矩阵。如果一个矩阵里大多数元素都是零,该矩阵即为稀疏矩阵。矩阵的空白元素(零)可以被压缩,在做矩阵乘法时可以跳过这些元素,而且,稀疏矩阵占用的GPU内存较少。

OpenAI的研究科学家Durk Kingma在向记者解释时表示,矩阵运算时的计算成本与矩阵中非零项的数量成正比。

使用稀疏矩阵就意味着节省下来的额外计算可用于构建横向更宽或纵向更深的网络,从而可以更高效地训练和执行推导运算,比率可高达十倍。

通过增加稀疏性后,密集神经网络(左)可以变成更宽(中)或更深(右)神经网络。 (图片来源:OpenAI)

Kingma表示,Nvidia其实并不支持稀疏模型。OpenAI的一个团队因此决定为广泛的研究社区开发核心程序(一种编译在硬件上运行的软件的小程序),核心程序是针对构建块状稀疏网络优化过的。

Elon Musk的人工智能研究部门的研究人员在内部利用OpenAI的核心程序训练长期短期记忆神经网络,这些神经网络被用于亚马逊和IMDB上评论文章的情绪分析。

研究人员在提交准备发表的文章(https://blog.openai.com/unsupervised-sentiment-neuron/)里表示,“我们的稀疏模型改善了文档级IMDB数据集截止目前为止的最好结果,由原来的5.91%错误率提高到5.01%。该改善结果与我们之前的结果比表现出了其潜力,原来的方法只有在处理短句层次文档时才能达到最佳效果。”

该核心程序是用CUDA编写的,OpenAI目前只为其开发了一个TensorFlow包装器,使用别的框架的研究人员需编写自己的包装器。还有,该核心程序仅支持Nvidia GPU。

Open AI的技术人员Scott Gray告诉记者,“该核心程序肯定可以扩展到其他支持小块矩阵乘法的架构,包括我知道的大多数架构,不过不包括Google的TPU2。“

Kingma说,尽管这些结果很有潜力,但“由于核心程序是新开发的,我们并不是明确知道核心程序在什么时候以及什么地方可以帮助神经网络架构。在实验中,我们提供了一些有助于在模型里添加稀疏性的例子。我们鼓励社区进一步探索这个空间。“

Gray做了补充,他表示,Nvidia已经获悉核心程序方面的工作,他们正在等代码发布后进一步提供更广泛的支持。

OpenAI的工作与Taco类似。Taco是由麻省理工学院的研究人员创建的一个软件,可自动生成处理稀疏矩阵的代码。

好文章,需要你的鼓励

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Piaggio Fast Forward与迪士尼联合推出Grogu主题版gitamini货运机器人,外观灵感来自《星球大战》中Grogu的悬浮婴儿车。该机器人基于现有gitamini平台改造,可自主跟随用户行走,最大承重20磅,搭载摄像头、传感器及专有导航软件,支持避障功能。此外,机器人配备星战主题灯光、音效及蓝牙音箱功能,可通过App自定义设置,目前已在官网及迪士尼商店开售。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

身份和访问管理公司Okta宣布扩展其"Okta for AI Agents"平台,新增与Amazon Bedrock的集成,并支持非Okta身份系统。该平台允许企业在不依赖单一供应商的情况下,发现、接入、保护和管理AI智能体。新功能包括影子智能体发现、Bedrock智能体直接导入、访问策略执行及一键关闭异常智能体等。此外,平台还向使用微软Entra ID等其他身份提供商的企业开放,提供统一的智能体身份控制平面。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整

Synetic在2026嵌入式视觉峰会上发布LYNX计算机视觉SDK

生数科技发布世界动作模型Motubrain,为机器人智能带来"无限可能"

xAI推出编程智能体Grok Build,加入竞争激烈的AI编程赛道