谷歌宣布公有云平台将支持面向人工智能的TPU芯片

谷歌今天宣布向其公有云平台上增加ensor Processing Units,这是一款专门为人工智能工作负载提供动力的内部设计的芯片系列。

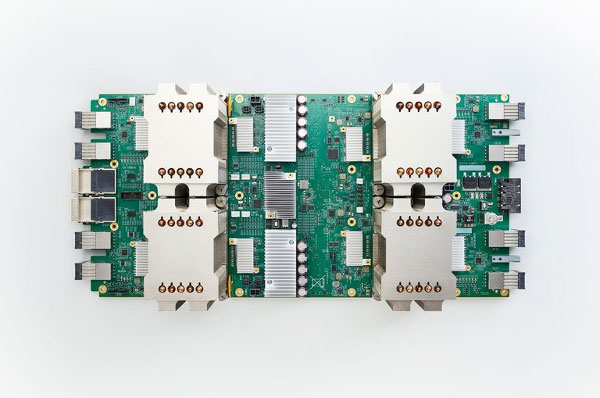

一个TPU(如图所示)由四个专用集成电路组成,配有64GB的“超高带宽”内存。这一组合单元可以提供高达180 teraflops的性能。今年晚些时候,谷歌计划增加一个集群选项,让云客户将多个TPU聚合成一个“Pod”,速度达到petaflop的范围(是teraflop的1000倍)。

在今天的公告中谷歌并没有分享更多的性能细节。不过,去年谷歌的两位顶级工程师写的一篇博客文章显示,当时内部使用的Pod包括64个TPU,总吞吐为11.5 petaflops。相比之下,世界上功能最强大的超级计算机可以达到93 petaflops,但值得注意的是,谷歌很可能没有使用相同的基准测试方法来测量TPU的速度。

无论哪种方式,这些芯片都是Google云平台的一个重要补充。当谷歌于去年4月首次向全世界展示TPU规格的时候,它透露该芯片至少可以运行某些机器学习工作负载,比现有的芯片快15至30倍。这就包括特别适合用于机器学习模型的GPU。GPU的主要制造商包括Nvidia和AMD公司,这两家公司仍然是当今大多数项目的首选。

因此,谷歌的云客户应该能够更快速地培训和运行他们的人工智能软件。谷歌表示,一个TPU可用于在一天之内实施主流ResNet-50图像分类模型,达到可接受的精确度水平。

谷歌已经创建了几个预先优化的神经网络包,让客户可以将其运行在TPU上,其中包括一个ResNet-50版本,以及用于机器翻译、语言建模和识别图像内物体的模型。企业客户也可以使用谷歌的开源TensorFlow机器学习引擎创建自己的人工智能工作负载。

喜欢使用传统图形卡进行人工智能项目的客户,今天也看到了一项新的功能。谷歌为其Kubernetes Engine服务添加了GPU支持,以允许将机器学习模型打包到软件容器中。后一种技术提供了一个轻量级抽象层,使开发人员能够更轻松地推出更新并跨环境迁移应用。

这个新的TPU价格为每小时每单元6.50美元,而通过Kubernetes Engine租赁的GPU将按谷歌现有的每种支持芯片型号收费。

这种芯片对于各种人工智能任务、特别是对于一些计算机工作负载而言的就绪情况,仍然不明确。Moor Insights&Strategy总裁兼首席分析师Patrick Moorhead表示:“TPU是一个很好的试水方式,但并一定适合于运行生产工作负载。GPU是进行训练的最佳方式。锁定到TPU,意味着被GCP和TensorFlow锁定。”

而且谷歌也不是唯一追求自主开发人工智能芯片的公司。芯片巨头英特尔公司一直在推销其最新用于人工智能工作负载的CPU,以及称为FPGA的定制芯片。

据The Information报道称,亚马逊公司正在开发自己的人工智能芯片,该芯片可以帮助其Echo智能音箱和其他使用其Alexa数字助理的硬件在设备上执行更多处理任务,以便它可以比调用云的响应速度更快。

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

香港城市大学与快手团队联手:让AI“导演“教会视频生成模型真正“思考“

这项研究提出"VLM即教师"框架,让视觉语言模型在视频生成推理时充当实时监考官,通过可微分奖励信号在线优化轻量LoRA模块,平均提升视频推理性能16.7分。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

新加坡科研机构最新成果:AI大模型里的“调光开关“,让每个专家按需开灯

这项来自新加坡科学技术研究局的研究提出了κ-SwiGLU,通过路由确信度动态调整专家门控灵敏度,在多种MoE模型上稳定提升性能,新增计算开销不足4%。

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功