微软首次推出27亿参数的Phi-2模型,性能超过许多大型语言模型

微软发布了一款名为Phi-2的人工智能模型,该模型表现出了不凡的能力,其性能可媲美甚至超越规模是其25倍的、更大、更成熟的模型。

微软在近日的一篇博文中宣布,Phi-2是一个拥有27亿参数的语言模型,与其他基础模型相比,它在复杂的基准测试中表现出了 "先进的性能",这些测试评估了推理、语言理解、数学、编码和常识能力。Phi-2现在通过微软Azure人工智能工作室的模型目录发布,这意味着研究人员和开发人员现在就可以将其集成到第三方应用程序中。

Phi-2由微软首席执行官Satya Nadella(如图)于11月在Ignite大会上首次发布,其强大的功能得益于该公司所称的“教科书质量”数据(专门针对知识),以及学习其他模型传递的洞见的技术。

Phi-2 的有趣之处在于,传统上,大型语言模型的能力总是与其总体规模密切相关,而总体规模是以参数来衡量的。参数越大的模型通常能力越强,但 Phi-2 的出现改变了这种状况。

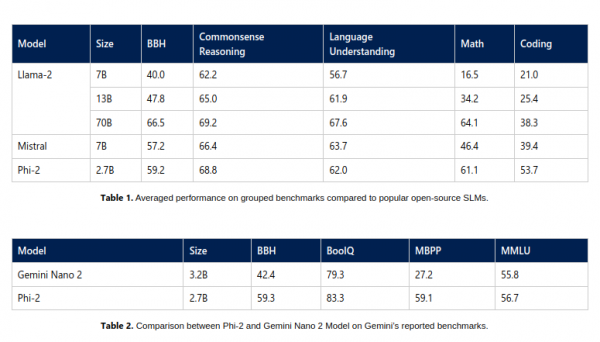

微软表示,Phi-2在某些基准测试中显示出与更大型的基础模型相匹敌甚至超越它们的能力,包括Mistral AI 70亿参数的Mistral、Meta Platforms公司130亿参数的Llama 2,甚至在某些基准测试中超过了700亿参数的Llama-2。

最令人惊讶的说法可能是,它的性能甚至超过了谷歌的 Gemini Nano,后者是上周发布的 Gemini系列LLM中效率最高的一款。Gemini Nano 专为设备上的任务而设计,可以在智能手机上运行,实现文本摘要、高级校对、语法修正以及上下文智能回复等功能。

微软的研究人员说,Phi-2涉及的测试非常广泛,包括语言理解、推理、数学、编码挑战等。

该公司表示,Phi-2之所以能取得如此优异的成绩,是因为它是用精心挑选的教科书级数据训练而成,这些数据旨在教授推理、知识和常识,这意味着它可以从更少的信息中学到更多的东西。微软的研究人员还使用了一些技术,允许从更小的模型中获取知识。

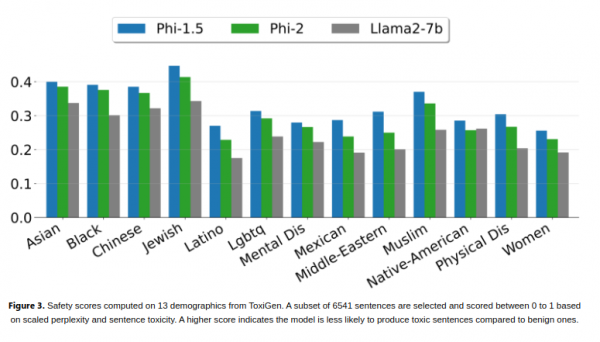

研究人员表示,值得注意的是,Phi-2可以不使用基于人类反馈的强化学习或者教学性微调等技术就实现强劲的性能,这些技术通常用于改善人工智能模型行为。尽管没有使用这些技术,但是与其他使用了这些技术的开源模型相比,Phi-2在减少偏见和有毒内容方面依然表现卓越。该公司认为这是量身定制的数据整理的功劳。

Phi-2是微软研究人员所称的“小型语言模型(SLM)”系列的最新版本。该系列第一个模型是 Phi-1,于今年早些时候首次发布,拥有13亿参数,针对基本的Python编码任务进行了微调。今年9月,该公司又推出了拥有13亿参数的Phi-1.5,使用新的数据源进行训练,其中包括用自然语言编程生成的各种合成文本。

微软表示,Phi-2的高效性使其成为研究人员探索增强人工智能安全性、可解释性和语言模型道德发展等领域的理想平台。

好文章,需要你的鼓励

利亚德沙特 LED 视效工厂预计 7 月投产,Micro LED 本地交付进入中东

今天讲的出海案例是利亚德,这家 1995 年成立、从 LED 显示产品研发生产销售起步,并做到小间距和 Micro LED 的视效科技公司,沙特工厂预计 2026 年 7 月投产。

达拉斯大学等机构联手破解AI“话痨“难题:让大模型聪明地“少说废话“

LEAD是一个让AI大模型按题目难度自动调节推理长度的训练方法,通过动态权重机制和按题定制目标长度,在不牺牲准确率的前提下显著减少冗余输出。

Locus Robotics收购Nexera Robotics,加速仓储机器人自主拣选能力升级

Locus Robotics宣布收购加拿大温哥华机器人公司Nexera Robotics,将其专有的NeuraGrasp末端执行器技术整合至Locus Array平台。NeuraGrasp融合AI抓取智能、计算机视觉及专利软膜结构,可动态适应不同形状、材质、重量的商品,显著扩大了可自主拣选的SKU类型范围。此次收购将加速Locus Robotics在移动操控领域的技术路线图,推动仓储全流程自动化履约能力迈上新台阶。

联邦国防军慕尼黑大学开发的“谎言识别器“:人工智能如何在百万条社交媒体帖子中揪出政治操控叙事?

联邦国防军慕尼黑大学研究团队开发的AI流水线,通过大型语言模型过滤和无监督聚类,在逾百万条社交媒体帖子中自动识别出41类政治操控叙事。

利亚德沙特 LED 视效工厂预计 7 月投产,Micro LED 本地交付进入中东

Locus Robotics收购Nexera Robotics,加速仓储机器人自主拣选能力升级

人形机器人ROI路径渐明,商业化成功关键在于有效产出

OpenBind发布首个AI药物发现模型,推动英国领跑AI制药领域

微软新AI系统发现16个Windows漏洞,含四个高危远程代码执行漏洞

索尼发布十周年纪念款1000X Collexion旗舰耳机,搭载Edge AI技术

索尼WH-1000XM6降噪耳机推出全新砂岩配色

特斯拉将在休斯顿附近建造大型太阳能电池板工厂

Stellantis计划推出起售价低于1.8万美元的平价电动车

LiveWire收购Dust Moto,正式进军电动越野摩托车市场

Romark Logistics携手Dexory,以AI驱动实时库存可视化平台革新仓储管理

Google Workspace全面升级:新增语音、图像编辑与收件箱AI功能