AWS面向旗下客户开放亚马逊Lex人工智能平台

ZD至顶网软件频道消息:AWS称亚马逊Lex人工智能服务面向旗下所有客户开放,客户可利用该服务构建应用程序。

亚马逊Lex的机器学习技术和亚马逊Alexa相同。应用程序利用亚马逊Lex拥有的算法功能可建立对话及处理语音和文本。

对于AWS而言,Lex面向广大的客户基群开放可以扩大系统规模。谷歌、微软和Facebook都在力推自己的人工智能平台。和大多数的科技一样,能够吸引最多开发者和现实世界应用程序的人工智能平台通常会成为赢家。

亚马逊Lex的另一个重点:AWS提供的人工智能是托管服务。因此,更多的企业可能会试用Lex和构建应用程序。以前未能构建和部署语音识别和自然语言应用程序的公司现在可以一试牛刀,而且可以构建具规模的系统。假若AWS 在Lex上取得成功的话,Lex则可以被置入数个人工智能应用引擎里。

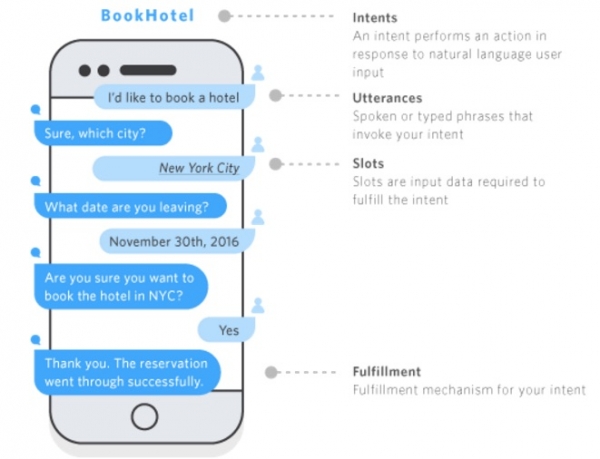

开发人员利用亚马逊Lex可以构建对话应用程序,对语音或文本输入进行解析。这些会话应用程序可以部署在移动设备或诸如Facebook Messenger和Slack等服务的机器人里。

几个要点:

- Capital One、Freshdesk、 Hubspot、Liberty Mutual、Ohio Health和Vonage等 AWS参考客户均是以亚马逊Lex为基础构建的。

- Lex是与云提供商AWS的无服务器托管服务AWS Lambda整合在一起的。

- 亚马逊Lex和Salesforce、Marketo和QuickBooks等SaaS应用程序之间有连接器可用。

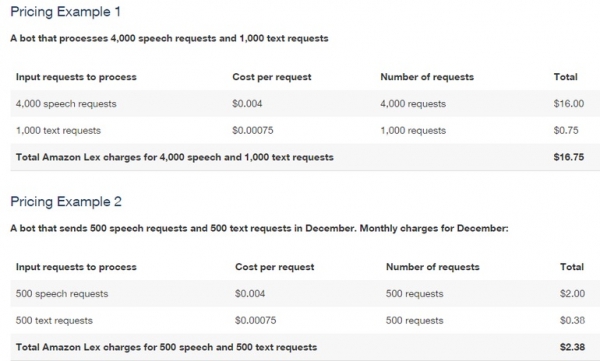

下图是亚马逊Lex的一些定价:

亚马逊Lex消息发布的同时,正在旧金山召开AWS峰会亦传出不少新闻。综合如下:

AWS宣布推出亚马逊红移光谱(Redshift Spectrum)功能,红移客户可利用红移光谱功能对自己的Amazon S3数据进行SQL查询操作。客户利用红移光谱可查询Amazon S3存储数据湖里的非结构化数据。

AWS推出亚马逊DynamoDB加速器。DynamoDB加速器为托管内存缓存服务,可以提高DynamoDB的响应时间性能。

亚马逊极光(Aurora)发布开放预览版,亚马逊极光兼容PostgreSQL。

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

马里兰大学出了个“免培训“数学AI方案:让大模型当“考官“,小模型边写边被纠错

马里兰大学提出无需训练奖励模型的数学推理方案,用大模型实时为小模型的分块生成过程打分选优,效果媲美专用过程奖励模型。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

上交大领衔研究:当AI助手需要管理你的微信群和小红书账号,它到底有多“菜“?

上交大等机构联合构建首个个性化MCP工具测评平台,测试超十款顶尖AI在飞书、小红书等真实个人账号场景的实际能力,结果显示无一模型准确率超过50%。

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议

Mentium Technologies Luna-R1 AI芯片入选ET-01星座任务,完成多星部署里程碑

汤道生×姚顺雨:腾讯AI下半场,拼的是“模型×产品”系统能力

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台