芝加哥大学赵燕斌:我们做的是让AI看不见的“艺术” 原创

生成式AI的发展呈现出一个有趣的悖论:它能够完美复现人类已有的智慧成果,却始终无法跨越训练数据的边界实现真正的创新突破。

正是这一特征让AI与艺术创作者处在剑拔弩张的关系中。当AI在几秒钟内模仿艺术家毕生锤炼的独特风格时,一个紧迫的问题浮出水面:如果给全球AI开发者设定一个必须要遵守的一个防护准则会是什么?

芝加哥大学计算机科学Neubauer教授赵燕斌(Ben Zhao)给出了一个发人深省的观点:在追求科研突破的同时,更需要深入思考技术可能带来的实际社会后果,这项责任落在每位科研工作者肩上。

当AI正在经历"摩尔式"狂奔时,我们比以往任何时候都更应思考,如何确保技术进步不会侵蚀文艺创作这一人类文明的珍贵财富。

这不仅关乎技术的未来,更关乎人类文化传承的根本。

芝加哥大学计算机科学Neubauer教授赵燕斌(Ben Zhao)

数据不是“万能药”

现在大家都在热议大模型,关注参数规模和准确率这些硬指标。但说实话,技术不能只停留在"能写会画",更重要的是能真正解决实际问题,这才是检验AI价值的试金石。

我们普遍看到的是,大模型在处理一些专业问题时,仍存在准确性不足的问题,即常说的“幻觉”现象。这使得人工智能要真正融入复杂的现实场景,仍面临诸多挑战。行业内正尝试通过引入RAG等技术路径,不断提升模型的可靠性和实用性。

尽管如此,业界普遍认为,无论是信息检索还是问答系统,大模型在多个应用场景中已具备替代人工进行交互的潜力。一些产品在应用大模型后,某些功能确实已经达到80%左右的可用性,这种"相对成功"让整个行业都非常兴奋。

这就使所有资源和关注点都集中在现有大模型架构上。然而,赵燕斌指出,从目前来看,大模型的能力仍然相对有限。尤其是在过去两年,大家不难发现其实际应用场景并不广泛,所以短期内大模型能在哪些领域实现突破,并真正替代人类完成部分工作,仍是存有疑问的。

但业界普遍倾向于相信“数据是万能钥匙”,只要训练的数据量足够大,模型就能持续优化,解决各种问题。无论是企业还是研究机构,似乎都在朝着“更多数据”的方向努力。

但从赵燕斌的研究角度来看,目前大模型在结构设计上本身存在一定的限制,换句话说,应用边界突破的根源并不只是数据不够多,而在于模型架构本身的限制。即使不断地堆叠数据,也无法从根本上解决问题。

未来几年内,这种依赖现有架构的方式可能会逐渐显露出瓶颈,也许我们需要退后几步,跳出当下的框架,从全新的角度重新思考模型的设计逻辑,寻找真正能够突破现有局限的新架构。

“以现在的节奏,我们可能没有办法把这些错误解决。”赵燕斌说。

当然,沿着大模型的发展曲线,产业内也涌现出一些创新,例如DeepSeek就被视为是一个重要拐点,虽然它没有根本性的改变架构本身,但是它提出了一个创造性的方法。

这也让之前大幅投入在硬件上的企业开始重新思考自己的战略方向。今年1月8日,微软亚洲研究院在arXiv上发表论文,提出一种创新方法rStar-Math,显著提升了小语言模型的数学推理能力,挑战了"参数越大性能越好"的传统认知,为GPU资源有限的机构提供了新思路,实现“花小钱办大事”。

在新技术出现时,宣传与实际落地之间存在落差是一个共性问题。“赵燕斌认为,现在企业真正将生成式AI应用在哪些场景,有多大的效率,目前还不能准确评估,只有当行业积累足够多的实践经验后,我们才能对这些技术的社会价值做出客观判断。

我们更多时候看新技术,往往更关注积极的一面,但生成式AI是一把双刃剑的事实也毋庸置疑,它带来的风险已不是停留在理论假设阶段,而是正在真实发生的现实。

给创意加一把“锁”

2016年,当AlphaGo以4:1的比分战胜围棋冠军李世石时,恰逢达特茅斯会议首次提出"人工智能"概念,过去整整一个甲子。彼时的赵燕斌就已经开始专注于解决机器学习和移动系统中的安全和隐私问题。

当时的他意识到,AI技术将对社会产生最深远的影响,其已在多个关键领域快速落地,无论是自动驾驶,还是医疗影像,这些突破性进展都令人振奋。

“正因如此,我们最初的研究重点就是如何保护这些有益的AI系统。”

在生成式AI兴起后,赵燕斌开始转向对抗性机器学习(Adversarial Machine Learning)的研究。由于AI模仿人类创作的能力突飞猛进,他带领团队开发出保护人类创意者免受生成式AI模型潜在危害的工具,这正是为了应对生成式AI技术逐渐成熟,但伦理规范尚待完善的发展阶段。

“这是一个自然的改变。”在赵燕斌看来,人工智能独特的算法机制展现了有意思的一面,但这些精妙的计算方式恰恰需要从安全角度被重新审视。

2013至2022年间,以分类任务为主的传统AI系统,在功能边界和局限性上相对明确,人们对它的表现有着清晰的预期。然而,自2022年以来,生成式AI展现出完全不同的特性,从文本分析,到辅助完成作业,对个人产生了重大影响,正是这种普适性也使其更具有挑战性。

所以赵燕斌的科研方向才做出了这样的转变,以往的研究只需从单一维度出发,但如今,AI技术的影响已变得高度复杂化,需要同时考虑效率提升等积极影响,以及可能产生的负面效应。

因为科研的结果很大程度会影响未来社会发展,这就要求研究者建立更全面的视角。以互联网为例,当时的主流观念认为技术创新本身就是好的,很少考虑其潜在的负面影响。然而,生成式AI的发展已经展现出完全不同的特征。

我们已经可以清晰地观察到,就业市场正在发生结构性变化,年轻一代艺术专业学生开始转型。作为一个从业数十年的计算机教授,赵燕斌几十年来第一次深刻感受到技术对跨学科才来的深刻的变化。

2022年夏天,一些艺术家主动联系了赵燕斌的团队,他们希望了解现有的科研成果,是否可以保护他们的创作不被大模型滥用。那时团队对艺术领域并没有太多的认知,对这一问题也感到意外,但经过和艺术家的深入交流,研究团队也意识到生成式AI对创作者带来的挑战远比想象的复杂。

为了解决这些现实问题,赵燕斌的团队开始利用对抗性机器学习针对艺术家群体的问题进行研究。对抗性机器学习是机器学习领域的一个重要分支,专注于研究如何让机器学习模型在对抗性攻击下保持鲁棒性。

而现在团队尝试利用这一机制,通过对输入数据进行微小而有针对性的修改,从而使模型产生错误的预测或分类结果,达到“隐身保护”的效果。这不仅是一次技术路径的跨界尝试,也代表在技术与伦理的平衡中找到一种新的可能性。

对抗的艺术“隐形”

如今艺术家们正面临两难的困境,作品需要放在网上被更多人看到,才可能产生收入,但同时更多的曝光,可能带来的就是作品被拿来用于AI训练。这种行为实质上剥夺了艺术家的创作价值和经济来源,甚至可能彻底摧毁其职业生涯。

赵燕斌团队开发的工具正是为了解决这个核心矛盾:如何在保持必要网络曝光的同时,有效保护艺术作品不被滥用,让创作者能够安心地在数字时代继续创作和发展。

在2020年,赵燕斌的团队就推出过一款图像遮蔽工具Fawkes,用来防止第三方根据网上的公开照片构建未经授权的面部识别模型。

在减轻AI危害的工具的研究上,赵燕斌的团队已经有了丰富的经验,并且通过与艺术家群体的深入交流,2024年又开发了Nightshade处理视觉艺术作品,使作品在未经同意就被用于AI模型训练时,能对模型产生干扰;以及Glaze,用来保护艺术家免受风格模仿的影响。

这些工具通过计算在画作上做出一些改变,经过特殊处理的作品,人肉眼并不会发觉,保持了其艺术性,但AI模型在分析这些经过处理的画作时,会受到干扰而无法准确识别。

Nightshade就好比“在你的午餐中加入辣椒酱,这样它就不会从办公室里的冰箱被偷走”。 Nightshade瞄准文本提示之间的关联,巧妙地改变图像像素,诱使大模型解读出与人类观看者完全不同的图像。大模型会错误地对“阴影”图像的特征进行分类,如果使用足够多的“中毒”数据进行训练,它们就会开始生成与相应提示完全无关的图像。

只需不到100个“中毒”样本就能破坏稳定扩散提示。未经修改的蒙娜丽莎图像和Nightshade处理过的版本对人类来说几乎完全相同,但大模型不会将“中毒”样本解读为女性肖像,而是会将其视为“一只穿着长袍的猫”。

从左至右:蒙娜丽莎;Nightshade处理版蒙娜丽莎;AI“看到”的蒙娜丽莎的阴影版本

“我们利用了人类和AI理解图像的根本差异。”赵燕斌说,人们欣赏画作依靠整体审美,而AI依赖数据特征分析。我们通过针对性调整画作的数字特征,在不改变视觉效果的前提下,使AI模型难以获取有效信息。

这种方法让艺术家可以安全地在网上展示作品,既保持曝光度,又降低被AI盗用的风险。自2024年1月发布以来,Nightshade的下载量已超过250万次,Glaze自2023年3月发布以来下载量达到760万次。

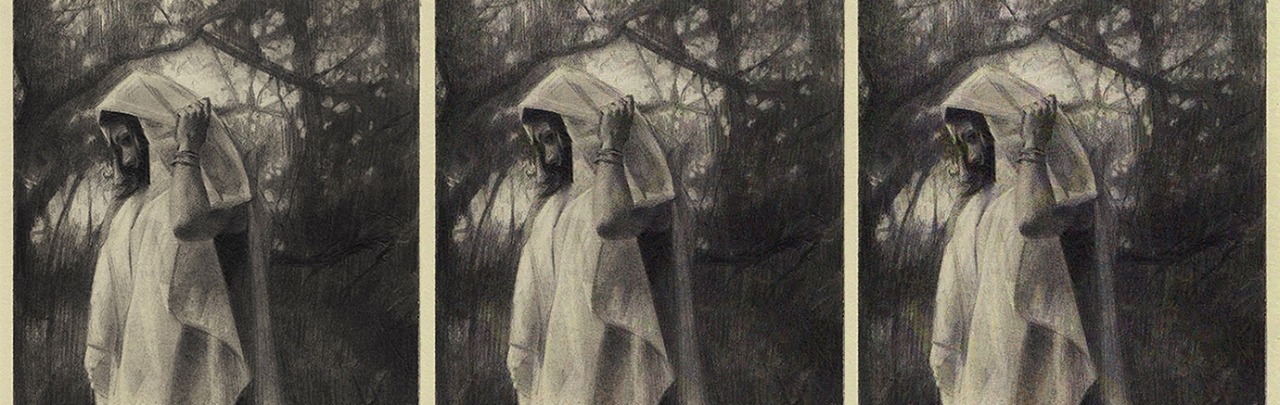

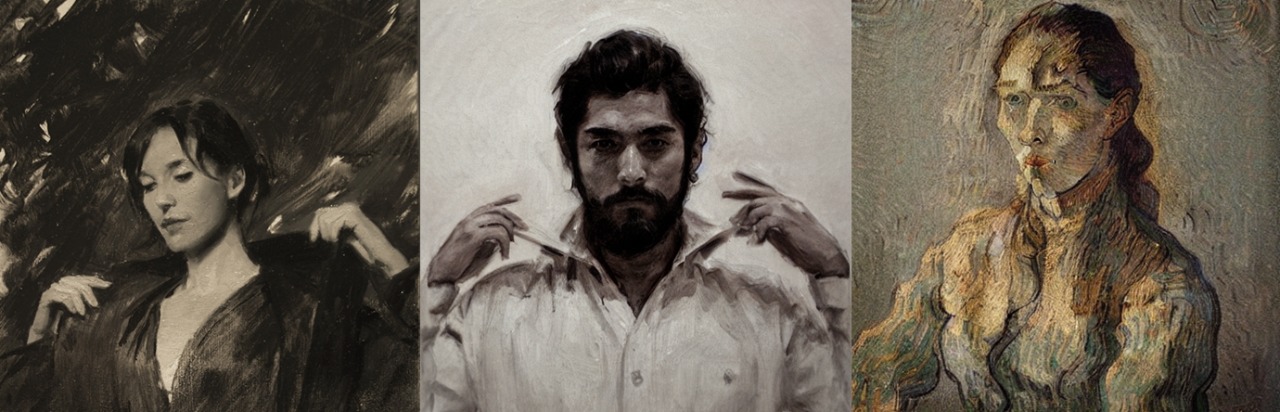

与Nightshade类似,Glaze工具可以扭曲大模型的“观看”和判断艺术风格的方式,防止其模仿艺术家的独特作品。人类可能会看到一幅“釉面”逼真的炭笔肖像,但大模型会将其视为抽象画,然后在被要求绘制精美炭笔肖像时,生成杂乱无章的抽象画。

从左至右:Karla Ortiz的原创作品;同一作品采用“低”隐身设置后的效果;同一作品采用“高”隐身设置后的效果

从左至右:Karla Ortiz的原创作品;AI模型创作的抄袭作品;隐藏原始艺术作品后AI生成的图像

这一研究成果让赵燕斌非常有价值感,因为这在保护人类创造力这一核心价值上具有重要意义。他说,创造力是人类区别于其他生物的本质特征,而艺术家、作家、音乐家等创意工作者正是这种创造力的重要代表。

保护这些创意人才,就是在守护人类文明的源泉。即便这项技术只能帮助少数创作者维护权益,就已经很有价值。若能扩大保护范围,其社会影响力将更为深远,因为这关系到人类文化生态的健康发展。

创意是AI发展的“原力”

对于创意产业,生成式AI的到来已经有了非常多的负面影响。只需几秒钟,生成式AI就能生成一本看似专业的书籍,或是搭建一个内容丰富的网站。但这些作品往往只是文字的堆砌,缺乏真正的思想和价值。

如今,在亚马逊等平台上,已经涌现出大量由AI改写而成的"新书",创作者只需对现有作品稍作修改,就能宣称是自己的原创。更令人担忧的是,这些AI生成的内容正充斥在网络中,让真实有价值的信息变得越来越难被“看见”。

那些花费一辈子打磨个人风格的画家,可能在一夜之间自己的艺术特色就被AI完美复制,而且这些被窃取的艺术风格,任何人都可以随意使用。

年轻的艺术学生们看到这样的情况,开始担心如果继续学习,未来是否能保证生机。艺术院校也因此受到严重冲击,40%-50%的学生看不到未来,转而学习其他技能,这导致一些拥有百年历史的艺术学院因此关闭。

生成式AI已经打乱了他们的未来,他们甚至怀疑:在AI时代,投入毕生精力追求艺术梦想是否还有意义?

赵燕斌的团队与全球的艺术家建立起交流渠道,几乎每天都会展开探讨。最初,赵燕斌也没有想到,他们的研究能产生这么大的关注和影响。

大部分艺术家的需求其实只有一点,就是不希望人工智能干扰他们的正常生活,他们只希望继续创造作品,全情的投入在创作中。

“在人工智能产出的作品越来越逼近人类作品时,真人的作品就更具价值。”赵燕斌认为,一张作品不仅需要好看,还需要有个人的意义和情感深埋其中,人工智能只能做到画面的颜色、结构等看起来是不是有美感。

在中国,我也接触过一些AI艺术家,他们通过AI生成出自己的创意,并对生成的内容进行二次创作,最终产出作品。但是他们用AI辅助创作的作品也正在被拿来抄袭,这是一件非常有趣且值得深思的现象。

生成式AI得模仿能力非常强,如果大家都互相模仿,未来我们看到的所有内容可能都是“千篇一律”的风格和感觉,从创新角度来说是灾难性的。

大模型最需要的是能有更多新鲜的信息提供给它进行训练,如果这些创意者都不再产出新内容,那大模型未来的创意是否会停滞不前?

当然,有人认为“风格模仿”也是艺术发展的一部分。在赵燕斌看来,这里存在一个关键差异:传统艺术学习与AI模仿的本质不同。人类学习另一位画家的风格是一个缓慢的渐进过程。当艺术家在街头看到一幅引人入胜的画作时,可能会从中获得灵感和启发,但绝不可能在五分钟内就完全掌握其风格精髓,更不用说批量产出上成千上万幅类似作品。

艺术家们互相学习借鉴,但绝不会纯粹为了模仿而模仿,更不会刻意与原作艺术家形成直接竞争关系。

给科研工作者的“启示”

赵燕斌教授因在AI防护工具领域的贡献而广为人知,他是国际计算机学会(ACM)会士,并获得了美国国家科学基金会早期职业生涯发展奖(NSF CAREER Award)、互联网防御奖和《麻省理工科技评论》35岁以下科技创新35人奖(MIT Technology Review’s TR-35 Award)等多个荣誉。

近期赵燕斌入选了2024年度全球人工智能百强榜单(TIME100 AI),他是其中少数入选的学术研究者。"这份榜单中企业界人士占绝大多数,来自学术界的教授仅有四五位。"赵燕斌表示,我们的基础研究能够产生如此广泛的实际影响,确实令人欣慰。

“入选吸引了一些媒体对我们的研究成果进行传播报道,对于这一研究方向带来了积极的影响。”更值得一提的是,赵燕斌的团队有机会与更有影响力的机构和个人建立合作关系。

尤其近期,赵燕斌与美国多个州政府展开交流,讨论人工智能技术的发展现状及其潜在风险。作为科研人员,他深刻认识到,除了通过技术手段直接帮助艺术家外,我们还需要为政策制定者提供专业的见解。

如今,人工智能已成为全球科研界最热门的领域之一,无论是中国、欧洲还是美国,投入该领域的研究人员数量都远超其他学科。这种迅猛的发展态势也带来了隐忧,许多潜在的社会影响常常在技术推进的过程中被忽视。

“正因如此,我们需要建立更加完善的科研体系。”赵燕斌说,只有当技术的发展能够确保为社会带来积极影响,同时有效规避负面效应时,才能实现真正健康可持续的AI进步。

赵燕斌的团队目前正从多个维度推进人工智能安全研究。一方面,分析AI模型在各种条件下的行为特征,包括受到攻击时的反应。另一方面,致力于开发保护机制,前瞻性地思考未来可能出现的挑战,例如在艺术创作领域如何区分人类作品与AI生成内容。

人工智能安全研究其实充满不确定性,很难准确预测每一项技术可能带来的所有后果。面对众多亟待解决的问题,赵燕斌的团队采取优先处理最具紧迫性的挑战,在实践中检验解决方案的有效性,并持续优化研究方向。

未来人工智能的发展,赵燕斌觉得有一点必须值得注意,计算机科学长期以来存在一种惯性思维:技术可行性是唯一的研究准则,为科研而科研。然而,在人工智能领域,这种思维模式已经不再适用,伦理考量和潜在影响同样重要。

他呼吁,年轻一代的AI学子尤其需要拓宽视野,在专注技术突破的同时,应当学习人文历史,培养社会洞察力。这种跨学科的素养能帮助他们判断:在何种情况下技术推进确实有益,何时又需要审慎考量潜在风险。

归根结底,衡量科研价值的核心标准不应仅是论文数量或奖项荣誉,而是这项研究最终能为社会带来什么样的实际影响。

这种责任意识的觉醒,或许是AI时代赋予科研工作者最重要的启示。

好文章,需要你的鼓励

世界模拟新引擎:阿里巴巴达摩院发布Inferix,让AI像导演一样制作超长视频

阿里巴巴达摩院联合浙江大学、香港科技大学发布Inferix,这是专为世界模拟打造的下一代推理引擎。它采用块扩散技术,像搭积木般分段生成视频,既保证高质量又支持任意长度,克服了传统方法的局限。配套LV-Bench评测基准包含1000个长视频样本,建立了分钟级视频生成的评估标准,为游戏、教育、娱乐等领域的内容创作带来革命性突破。

Luma AI推出终端速度匹配:一步生成高质量图像的革命性突破

Luma AI推出的终端速度匹配(TVM)是一种革命性的图像生成技术,能够在单次计算中生成高质量图像,突破了传统方法需要数十步采样的限制。该技术通过关注生成路径的"终点"而非"起点",实现了从噪声到图像的直接跳跃,在保证数学理论基础的同时大幅提升了生成效率,为实时AI应用开辟了新路径。

五位自动驾驶产业链大咖畅谈:未来运输的模式、通路与破壁

智能数据将开启AI赋能设计的新纪元

OpenAI 科学家:为什么大语言模型会产生幻觉?

从太空到地面:Qorvo波束成形芯片助力卫星通信发展

豆包语音对话功能更新,能讲4种地道方言,具备思考能力

联想刘军获评“年度科技领军人物” 前瞻布局和实践打造AI落地范本

贝索斯"普罗米修斯项目"收购AI智能体初创公司

全新Mac浏览器Orion发布:主打速度与隐私保护

Opera AI浏览器推出1分钟深度研究模式和Gemini 3 Pro集成

马斯克xAI计划在Colossus数据中心旁建设小型太阳能发电场

微软联手思科那发布零信任光网络架构框架

国内唯一,阿里千问斩获NeurIPS 2025最佳论文奖