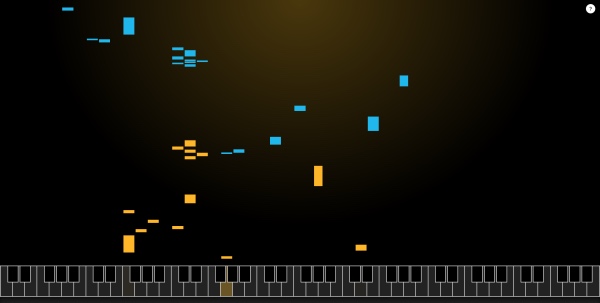

谷歌人工智能二重奏 机器人与人钢琴合奏

谷歌半年多以前公布推出可以演奏钢琴的人工智能程序,该人工智能程序可以将一些给定的音符变成一首歌。搜索巨头谷歌日前决定与全世界分享旗下的人工智能二重奏网络应用程序。

YotamMann是一名音乐家,同时也是码农,他是上述新的人工智能程序的幕后人。他在谷歌Magenta和Creative Labs团队的帮助下创建该人工智能程序。Mann在一个视频中解释了该人工智能程序幕后的过程以及人工智能程序如何在拿到乐谱后即时弹奏新的音乐。

Mann表示,“利用代码做音乐并不是新事物,但机器学习为我们提供了一个不同的方法。假如我试图用更传统的编程去写人工智能二重奏程序的话,那我就必须写许多规则。”

曼解释说,假如用人工智能编程的旧方法,他就必须告诉计算机如何去对各种输入作出响应,而各种可能的输入非常多,要这样做是不可能的。他表示,“我主要是创建一个映射去告诉计算机如何做出这些决定,但音符和时间的组合太多,用人手映射是做不到的。”

Mann用神经网络训练人工智能二重奏程序,而不是用特定的规则编程。神经网络技术的工作原理有些像人类的大脑,一些人工神经元合力构成连接并且强化现存的知识。

谷歌将大量音符组合输送给上述的人工智能程序,该人工智能程序从这些数据里学习常常同时演奏或先后演奏的音符之间的连接、时间关系等等。你弹了几个音符后,人工智能二重奏程序就会将其数据与神经网络里的连接比较,再决定从几种可能里选一个连接演奏。Mann表示,不管你给的是什么,人工智能二重奏程序都会尝试给你伴奏,即使你砸几下键盘,它也会以相应的节奏和旋律给你伴奏。

Mann构建人工智能二重奏程序用到Magenta。Magenta是一个谷歌大脑团队用TensorFlow建造的开源深度学习库。人工智能二重奏的代码也是开源的,所以如果你想建造一款自己的演奏钢琴的机器人,现在可以开始了。

笔者与谷歌人工智能二重奏程序演奏的结果不是特别顺溜,但或许人工智能二重奏程序的弹奏水平不会超过弹奏伙伴吧。不管怎么样,人工智能二重奏程序还是没可能和我们玩“筷子”法合奏。

好文章,需要你的鼓励

Allen AI团队推出SAGE:首个能像人类一样“想看多长就看多长“的智能视频分析系统

Allen AI研究所联合多家顶尖机构推出SAGE智能视频分析系统,首次实现类人化的"任意时长推理"能力。该系统能根据问题复杂程度灵活调整分析策略,配备六种智能工具进行协同分析,在处理10分钟以上视频时准确率提升8.2%。研究团队创建了包含1744个真实娱乐视频问题的SAGE-Bench评估平台,并采用创新的AI生成训练数据方法,为视频AI技术的实际应用开辟了新路径。

联想推出DE6600系列:更智能的存储解决方案

联想推出新一代NVMe存储解决方案DE6600系列,包含全闪存DE6600F和混合存储DE6600H两款型号。该系列产品延迟低于100微秒,支持多种连接协议,2U机架可容纳24块NVMe驱动器。容量可从367TB扩展至1.798PiB全闪存或7.741PiB混合配置,适用于AI、高性能计算、实时分析等场景,并配备双活控制器和XClarity统一管理平台。

AI视觉模型真的能看懂长篇文档吗?中科院团队首次揭开视觉文本压缩的真相

中科院团队首次系统评估了AI视觉模型在文本压缩环境下的理解能力,发现虽然AI能准确识别压缩图像中的文字,但在理解深层含义、建立关联推理方面表现不佳。研究通过VTCBench测试系统揭示了AI存在"位置偏差"等问题,为视觉文本压缩技术的改进指明方向。

数智时代,openGauss Summit 2025即将发布哪些技术创新破局

“算力+储能”深度融合:超智算发布分布式算力超级节点储能解决方案

联想推出DE6600系列:更智能的存储解决方案

创业公司如何在严格监管行业中实现生死攸关的创新

OpenAI发布GPT-5.2-Codex模型,软件工程自动化能力大幅提升

Waterfox浏览器宣布拒绝AI功能,瞄准Firefox忠实用户

TikTok美国业务出售交易将于下月完成

破局AI数据中心安全瓶颈:Fortinet联合NVIDIA引领隔离式加速新航向

智算中心进化论,科华数据如何做到“更懂”

更高负载、更快建设:2026年数据中心六大趋势

Snowflake数据库更新引发全球大规模服务中断

AI编程初创公司Lovable融资3.3亿美元,英伟达等科技巨头支持