英伟达下一款Linux驱动程序开源了,但又没完全开源

对于英伟达Grace Hopper以及英伟达Blackwell等前沿平台,您只能使用开源GPU内核模块。这些平台不支持专有驱动程序。

英伟达进行今年的第四次收购,扩展人工智能云能力

最新被英伟达收入囊中的初创公司Brev.dev可以帮助AI开发人员在云供应商中找到最具成本效益的GPU计算。在此之前,英伟达还收购了另外两家初创公司,目的很明确,就是为了扩展其 DGX Cloud 服务的功能。

AIST联手HPE与英伟达,合作开发下一代AI云计算设备

日本国家先进工业科学与技术研究所(AIST)计划安装其第三代AI桥接云基础设施3.0(AI Bridging Cloud Infrastructure 3.0)超级计算机。而且正如大家所想象,这套系统将包含数千张英伟达最新一代“Hopper”H200 GPU加速器。

据报道,英伟达以1亿美元的价格收购事件自动化初创公司 Shoreline

据报道,英伟达公司已同意收购事件自动化初创公司Shoreline,但两家公司目前均未证实这笔交易。

AI芯片对决:英特尔GAUDI与英伟达GPU

因此,英特尔在Computex简报会上公布了产品的定价与基准测试性能,以期展示Gaudi 3与当前“Hopper”H100 GPU的直接比较结果。

英伟达通过数字孪生加速工厂智能化

英伟达称有十多家公司正在利用旗下的数字孪生和Omniverse三维数字技术重新创建工厂及更高效的实体工厂,工程师可以针对数字化工厂进行各种操作,进而提高效率。

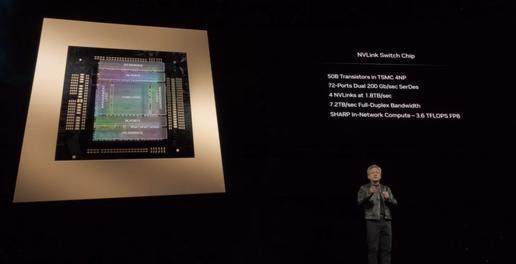

英伟达公布截至2027年的GPU与互联技术路线图

作为八大科技巨头共同打造的、用于对抗英伟达的交换技术,让GPU巨头采用UALink当然有点荒谬。但谁知道呢,毕竟技术行业从来不缺少出人意料的故事。

微软、英伟达和其他科技巨头的首席执行官加入联邦人工智能顾问委员会

一群著名科技公司的高管将加入人工智能安全保障委员会(Artificial Intelligence Safety and Security Board),该委员会的任务是就人工智能在关键基础设施中的应用向联邦政府提供建议。

英伟达公布研究成果,助力AI生成图像与3D提速

英伟达多伦多AI实验室的研究人员正努力解决生成图像与视频的时间问题。在本周英伟达GTC 2024大会上,他们概述了这项工作的部分成果,展示的相关进展有助于更快(因此更经济)生成“噪声”更少的图像与细节更丰富的3D图形,甚至能够将以往耗时几周或几个月的任务缩短至几天乃至几分钟。

英伟达BLACKWELL系统如何“吃下”万亿级参数AI模型

可以看到,单纯将Hopper替换为Blackwell并不是最好的答案。根据英伟达方面的解释,只有在配合一系列正确举措之后,推理性能提升至30倍、推理功耗降低至1/25的结果才有可能实现。

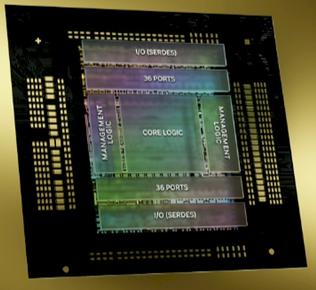

NVIDIA最新“王炸” 最强“芯”开启30倍AI算力 征服AI生态版图疆域

2016 年,老黄扛着第一个DGX 系统给了 OpenAI,于是有了如今的 ChatGPT。如今,为了帮助世界构建更大的 AI,英伟达拿出了新的GPU。老黄说:这是一块非常非常大的GPU!

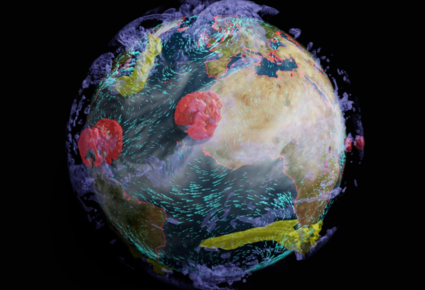

英伟达发布“地球2号”数字孪生,可以预测地球气候变化

“地球2号”在GTC大会上正式亮相,旨在以前所未有的规模模拟天气与气候,并将其可视化,为更准确的预测和及时的预警铺平道路。

BLACKWELL GPU亮相:AI从此更便宜、更简单,英伟达竞争优势愈发凸显

日前在圣何塞举行的2024年GPU技术大会上公布的英伟达“Blackwell”GPU,是这家计算引擎制造商推出的第七代、也是最令人印象深刻的数据中心级GPU。GPU计算浪潮始于2000年代中期,并随着2012年5月“Kepler”K10与K20加速器的推出而变得愈发清晰具体。

走进芯时代:AI算力GPU芯片分析

尽管AI芯片种类繁多,GPU因其适应性和强大的并行计算能力,仍是AI模型训练的主流硬件。英伟达在GPU领域的技术积累和生态建设使其处于领先地位,而国内GPU厂商虽在追赶,但仍存在差距。AI应用向云、边、端全维度发展,模型小型化技术成熟,数据传输需求增加,Chiplet技术降低设计复杂度和成本。

英伟达推出”生成式AI专业认证“,帮你成为大模型开发专家!

英伟达推出了生成式AI(AIGC)专业认证,旨在通过考试提供行业认可的权威证书,并提供相应的培训课程。认证内容涵盖生成式AI和大语言模型知识,考试为远程方式,适合多种AI相关职业人士。

EOS只能半速运行:就连英伟达也无法为自家超级计算机提供充足H100 GPU

要说当下最困难的挑战,就是如何为计算系统采购充足的英伟达“Hopper”H100 GPU。哪怕是作为供应商的英伟达自己,也只能在有限的配额之下谨慎规划、调拨给内部使用。

英伟达推出用于AI加速设计工作负载的RTX 2000 Ada Generation GPU

英伟达公司今天推出了新的Nvidia RTX 2000 Ada Generation GPU,将更强大的生成式人工智能处理器打包到“紧凑型工作站”中,让用户能够在设备上运行高级AI应用程序。